Yeni normal: Verimlilik mi, görünmeyen risk mi?

Son dönemde iş hayatında sessiz ama çok hızlı bir dönüşüm yaşanıyor. Eskiden saatler süren işler artık birkaç dakikada tamamlanabiliyor. Bir sözleşmenin özeti çıkarılıyor, tatmin edici çeviriler yapılıyor, müşteri e-postası yazılıyor, hatta karmaşık bir Excel analizi bile birkaç prompt ile çözülebiliyor. Bu dönüşümün merkezinde ise üretken yapay zekâ araçları var. Claude, ChatGPT, Gemini, Copilot gibi araçlar artık birçok çalışan için günlük iş akışının doğal bir parçası haline gelmiş durumda.

Ancak bu yeni normal beraberinde pek de fark edilmeyen bir soruyu getiriyor: Bu araçları kullanırken aslında neyi, kime verdiğimizin farkında mıyız?

Kişisel Verileri Koruma Kurumu’nun (“Kurum”) yayımladığı “İş Yerlerinde Üretken Yapay Zekâ Araçlarının Kullanımı” dokümanı tam olarak bu noktaya odaklanıyor. Bu doküman klasik anlamda bir “yapay zekâ regülasyonu” değil. Kurum burada yapay zekânın kendisini değil, çalışanların bu teknolojiyi kullanma biçimini mercek altına alıyor. Başka bir deyişle, sorun teknolojide değil; teknolojinin kontrolsüz ve bilinçsiz kullanımında.

Dokümanın merkezine aldığı “Shadow AI” yani “Gölge Yapay Zekâ” kavramı da bu yaklaşımı çok iyi özetliyor. Şirket yönetiminin bilgisi ve kontrolü dışında çalışanların bireysel olarak yapay zekâ araçlarını kullanması artık yeni bir risk kategorisi olarak karşımıza çıkıyor.

Risk nerede başlıyor: Veri, kontrol ve farkındalık eksikliği

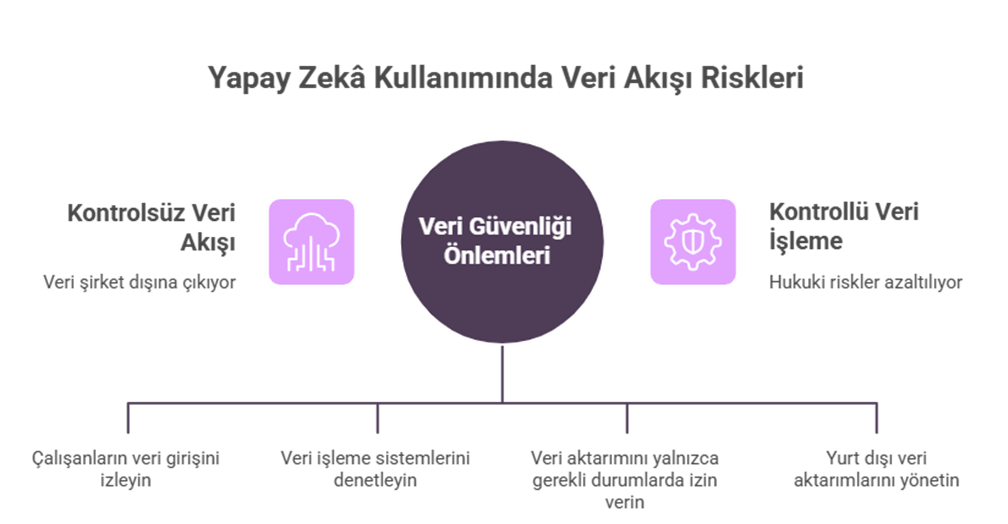

Üretken yapay zekâ araçlarının doğası gereği, sistemle etkileşim kurabilmek için veri paylaşmanız gerekiyor. Çalışan bir sözleşmeyi özetletmek istediğinde, o sözleşmenin içeriğini sisteme giriyor. Bir müşteri e-postasını iyileştirmek istediğinde, müşteri verisini prompt olarak yazıyor. Bir analiz yaptırmak istediğinde, veri setini yükleyebiliyor. Bu noktada çoğu zaman fark edilmeyen şey şu: Bu veriler şirket içindeki bir sistemde değil, üçüncü taraf bir platformda işleniyor.

Risk sadece kişisel verilerle sınırlı değil. Ticari sırlar açısından da benzer bir tehlike söz konusu. Şirket stratejileri, fiyatlandırma politikaları, sözleşme taslakları veya henüz kamuya açıklanmamış projeler gibi hassas bilgiler de aynı şekilde yapay zekâ sistemlerine aktarılabiliyor. Bu da veri koruma hukukunun ötesine geçerek doğrudan şirketin rekabet avantajını etkileyebilecek bir risk alanı yaratıyor.

Buna ek olarak, üretken yapay zekâ sistemlerinin doğası gereği hatalı veya yanıltıcı sonuçlar üretebilmesi de ayrı bir risk katmanı oluşturuyor. “Halüsinasyon” olarak adlandırılan bu durum, sistemin gerçek olmayan ancak oldukça ikna edici çıktılar üretmesi anlamına geliyor. Çalışanların bu çıktıları yeterli kontrol mekanizmalarından geçirmeden kullanması ise hukuki, finansal ve operasyonel riskleri beraberinde getirebiliyor.

Belki de en kritik nokta ise şu: Şirketlerin önemli bir kısmı bu kullanımın farkında bile değil. Hangi çalışan hangi aracı kullanıyor, hangi veriler paylaşılmış, bu veriler nerede işleniyor gibi soruların çoğu zaman net bir cevabı yok. Bu da görünmeyen ama giderek büyüyen bir risk alanı yaratıyor.

KVKK’nın yaklaşımı: Yasaklamak değil, yönetmek

Kurumun bu dokümanla verdiği mesaj aslında oldukça net: Yapay zekâ kullanımını yasaklamak değil, etkin bir şekilde yönetmek gerekiyor. Zira bu araçlar artık iş hayatının ayrılmaz bir parçası hâline geldi ve sundukları verimlilik avantajı göz ardı edilemez düzeye ulaştı. Bununla birlikte bu yönetim yaklaşımı, yalnızca politika ve kontrol mekanizmalarıyla sınırlı olmayıp şirketler açısından aynı zamanda yeni bir teknoloji yatırımı ihtiyacını da beraberinde getirmekte. Nitekim çalışanlara, bireysel olarak erişilebilen gelişmiş modellerin gerisinde kalan ve sınırlı yeteneklere sahip kurumsal yapay zekâ araçlarının sunulması, “Shadow AI” kullanımını azaltmak yerine teşvik edebilmekte; bu da kontrolsüz veri paylaşımı riskini artırarak mevcut sorunları daha karmaşık hâle getirebilmekte. Dolayısıyla gölge yapay zekâ kullanımını asgari seviyede tutmanın yolu, yalnızca yasaklayıcı veya kısıtlayıcı önlemlerden değil, teknolojik gelişmeleri yakından takip ederek çalışanlara rekabetçi, güvenli ve işlevsel yapay zekâ çözümleri sunmaktan geçiyor..

Bu kapsamda şirketlerin öncelikle üretken yapay zekâ kullanımına ilişkin açık ve net bir politika oluşturması gerekiyor. Hangi araçların kullanılabileceği, hangi verilerin kesinlikle bu sistemlere yüklenmemesi gerektiği ve hangi durumlarda ek onay mekanizmalarının devreye gireceği gibi konuların belirlenmesi kritik önem taşıyor. Bununla birlikte çalışanların bu konuda bilinçlendirilmesi de en az politika oluşturmak kadar önemli. Zira mevcut risklerin önemli bir kısmı kötü niyetten değil, farkındalık eksikliğinden kaynaklanıyor.

Veri minimizasyonu ilkesi de bu noktada öne çıkıyor. Yapay zekâ araçlarına mümkün olduğunca kişisel veri içermeyen veya anonimleştirilmiş veri ile yaklaşmak, riskleri önemli ölçüde azaltabilir. Ayrıca bu araçlardan elde edilen çıktılara doğrudan güvenmek yerine, mutlaka bir insan kontrolünden geçirilmesi gerektiği de unutulmamalı.

Bu doküman aynı zamanda KVKK yaklaşımında önemli bir kırılmaya da işaret ediyor. Geleneksel veri koruma yaklaşımı daha çok sistemler ve süreçler üzerine kuruluyken, burada doğrudan çalışan davranışı ve günlük iş pratikleri hedef alınıyor. Bu da veri koruma hukukunun giderek daha operasyonel bir alana evrildiğini gösteriyor.

Avukatlar için yeni bir alan: Risk yönetimi bugünden başlıyor

Son olarak, bu gelişmenin sadece şirketler açısından değil, hukukçular açısından da önemli bir dönüşüm anlamına geldiğini söylemek gerekiyor. Üretken yapay zekâ artık sadece bir teknoloji meselesi değil; aynı zamanda veri koruma, sözleşme hukuku, sorumluluk rejimi ve hatta rekabet hukuku gibi birçok alanı kesen yeni bir risk alanı yaratıyor.

Bu nedenle KVKK alanında çalışan avukatların da bu teknolojinin doğurduğu riskler üzerine şimdiden yoğunlaşması gerekiyor. Çünkü açık olan şu: Yapay zekâ kullanımına ilişkin riskler henüz tam anlamıyla regüle edilmiş değil, ancak etkileri şimdiden oldukça somut. Bu alanda erken pozisyon alanlar riskleri yönetirken, geç kalanlar büyük ihtimalle kriz yönetmek zorunda kalacak.

Bugün “Ben bunu ChatGPT’de hallettim” cümlesi verimlilik göstergesi gibi görünebilir. Ancak doğru yönetilmediği takdirde, bu cümle aynı zamanda bir KVKK ihlalinin başlangıç noktası da olabilir.